Algoritmo" e "inteligencia artificial" tal vez fueron las palabras más usadas en el mundo de la tecnología de 2019. ¿Qué significaron para nuestras vidas? Fórmulas, pensadas por personas, para tomar decisiones que resuelven problemas. Si además se decide sobre un conjunto grande de datos, estaremos en presencia de una decisión automatizada que suele llamarse, para dejarnos contentos con la ciencia ficción, inteligencia artificial.

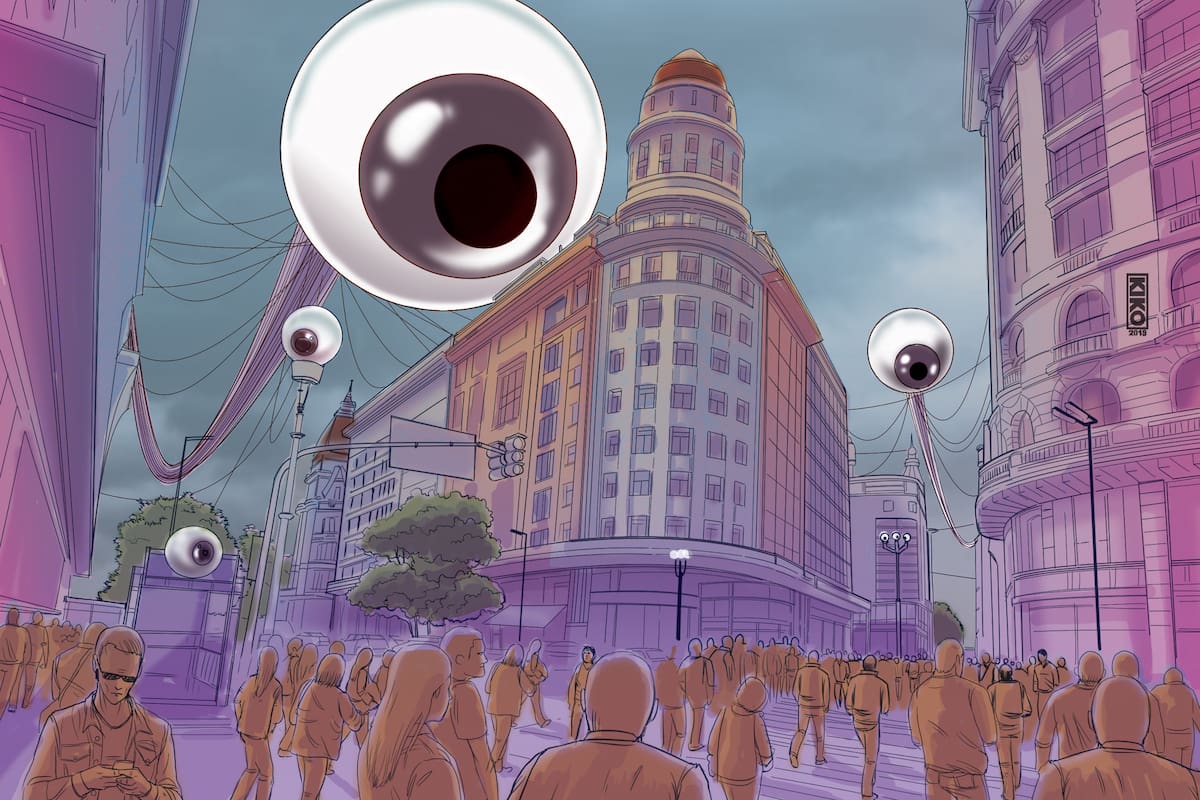

Entre los despliegues más recientes y sobre todo masivos de ese tipo de tecnologías, el reconocimiento facial está llegando a nuestras ciudades. El invento no es nuevo, pero con las mejoras en las capacidades de procesamiento, que permiten analizar más información con mayor velocidad, creció exponencialmente la instalación de estas herramientas en los más diversos escenarios de nuestra vida cotidiana: desde las cámaras de seguridad hasta su uso en las escuelas.

Impulsado por un fuerte lobby de las empresas que las desarrollan, con jugadores globales como la japonesa NEC, la francesa Idemia o la norteamericana IBM, el reconocimiento facial comenzó a ser implementado por gobiernos de todo el mundo en la búsqueda de una respuesta fácil y novedosa a problemas estructurales mucho más complejos, como la seguridad, pero que siempre esperan alguna dosis mágica para aliviar el dolor mientras se encuentra la cura a la enfermedad estructural (la desigualdad social).

Durante su campaña por la reelección a la jefatura de Gobierno por la Ciudad de Buenos Aires, el actual intendente Horacio Rodríguez Larreta, que ya había iniciado un plan de implementación de reconocimiento facial en las ya instaladas cámaras de seguridad porteñas, anunció, en varias oportunidades, que la red se iba a ampliar hasta llegar a los 10.000 dispositivos con uso de esta tecnología. Estas cámaras funcionan mediante alertas que buscan atrapar delincuentes mediante la coincidencia de los rostros de personas que estén incluidas en la base de datos del CoNaRC (Consulta Nacional de Rebeldías y Capturas), conformada por unos 46.000 datos aportados por la Justicia Federal. Según las autoridades, la exactitud del sistema es de entre el 95% y el 99%.

Sin embargo, el mundo todavía no se pone de acuerdo en que el reconocimiento facial sea una tecnología madura. El software de reconocimiento facial puede llegar a tener altos porcentajes de falsos positivos, como en el caso de las pruebas realizadas por la Metropolitan Police de Londres entre 2016 y 2018, las cuales resultaron en un 96% de personas mal identificadas como presuntas criminales.

Diversos estudios confirman que el reconocimiento facial es una tecnología que ayuda a amplificar los prejuicios de las fuerzas de seguridad y pone en jaque el ejercicio de derechos fundamentales y garantías constitucionales, reforzando la discriminación según la tez o el género de las personas, además de poner en riesgo la presunción de inocencia y el debido proceso. En Estados Unidos, un análisis de los algoritmos de reconocimiento facial evaluados por el Instituto Nacional de Estándares y Tecnología (NIST, por sus siglas en inglés) encontró que el desempeño del software es más preciso cuando se usa sobre la población que lo desarrolló, lo que lleva a una discriminación en base a la tez o el género de las personas. Esto es particularmente preocupante dado que el tratamiento de esta tecnología se desarrolla mayormente por jóvenes, adultos, varones y blancos, pero luego se utiliza, principalmente, contra grupos vulnerables y minorías. Según la American Civil Liberties Union (ACLU), el reconocimiento facial falla en analizar con precisión a las personas con tez oscura, clasificando erróneamente a mujeres afroamericanas como hombres y evaluando a hombres afroamericanos como "agresivos" aunque su expresión facial sea neutral.

También se repite que este tipo de tecnologías suelen aplicarse sin un debate previo respecto de cómo afectan las libertades de las personas, sobre la proporcionalidad de adoptar una tecnología para un fin, y menos aún sin una evaluación anterior de la situación por la cual el Estado compra –en este caso, un software– una solución. A partir de estos debates y de la alta tasa de errores, ciudades como San Francisco, Cambridge, Oakland y Somerville –las dos primeras, íconos del desarrollo tecnológico global– tomaron acciones concretas para limitar el uso gubernamental del reconocimiento facial. También, expertos en el mundo proponen establecer moratorias para que este tipo de tecnologías no se apliquen hasta contar con desarrollos con menos sesgos y con debates más democráticos. O, simplemente, optar por no aplicarlos.

En la Argentina, durante 2019, la Asociación por los Derechos Civiles (ADC) presentó una serie de pedidos de informe al Gobierno de la Ciudad para averiguar sobre qué parámetros había adquirido la tecnología de reconocimiento facial, tan cuestionada en el mundo. Luego, en el mes de octubre, la organización presentó una Acción Declarativa de Inconstitucionalidad contra el Gobierno de la Ciudad de Buenos Aires para que la resolución, que crea el Sistema de Reconocimiento Facial de Prófugos, pierda vigencia y se determine que va en contra de las constituciones, la local y la nacional. Entre otros argumentos, la ADC señala que la implementación de tecnología nunca puede desentenderse del contexto en el que se aplica: en nuestro caso, una sociedad marcada por la desigualdad en la cual esta tecnología puede contribuir a una mayor desigualdad. Por otro lado, pensar si con estas herramientas no se reducen las expresiones críticas, por el efecto de vigilancia y control que generan, contrarios a la democracia.

Durante 2020, el debate seguirá y se volverá, seguramente, más activo, tanto en la Argentina como en el mundo. Las decisiones automatizadas y la implementación de tecnologías que parecen inminentes y siempre dispuestas a resolver problemas a veces necesitan límites. Casi siempre, también, necesitan debates. Si eso no ocurre, como señaló en su último reporte Philip Alston, el Relator Especial por la Pobreza y los Derechos Humanos de la ONU, los Estados empiezan a actuar como zombis, adoptando tecnologías sin conocer los costos. Y, si para algo todavía somos humanos, es para conocerlos y remediarlos.