Servidores sin control. Así funcionan las comunidades que comparten contenido violento: relatos de ataques, ironía y códigos propios en comunidades online

En grupos abiertos y cerrados, este medio relevó intercambios en los que conviven humor, códigos propios y relatos explícitos sin cuestionamientos

6 minutos de lectura'

6 minutos de lectura'

Detrás de chats que, a simple vista, combinan humor, memes y conversaciones cotidianas, se despliega un universo paralelo con reglas propias y escasa moderación. En servidores de Discord, una de las plataformas más utilizadas por adolescentes y jóvenes para interactuar en tiempo real, conviven intercambios inofensivos con otros atravesados por referencias a la violencia extrema.

En ese contexto, LA NACION se infiltró en distintos grupos −algunos abiertos y otros de acceso restringido mediante invitación− y detectó mensajes, imágenes y diálogos que circulan sin filtros en comunidades con cientos y, en algunos casos, miles de integrantes.

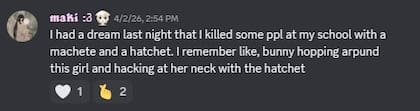

En esos espacios, este medio pudo observar mensajes en inglés y español que naturalizan escenas de violencia explícita. “I had a dream last night that I killed some ppl at my school with a machete and a hatchet. I remember like, bunny hopping around this girl and hacking at her neck with the hatchet” (Anoche soñé que mataba a algunas personas en mi escuela con un machete y una hacha. Recuerdo que saltaba alrededor de una chica y le golpeaba el cuello con el hacha), escribió un usuario en uno de los canales. El mensaje no fue aislado ni generó rechazo inmediato: quedó integrado al flujo constante de publicaciones.

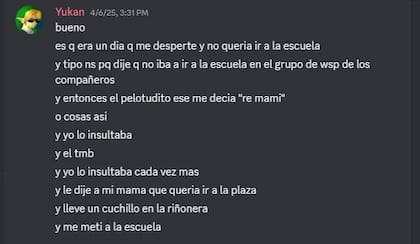

En otro grupo, en español, un usuario relató: “Es más, ya ni es más mi amigo pq llevé un cuchillo a la escuela y le corté la cara pq el man me molestaba y me decía pelotudeces en el grupo de wsp”. La naturalidad del relato y la ausencia de cuestionamientos evidencian una dinámica donde la violencia es narrada sin filtros y, muchas veces, sin consecuencias visibles dentro de la comunidad.

LA NACION pudo constatar que estos contenidos −mensajes, imágenes y referencias a ataques− circulan al menos desde el año pasado en los canales públicos. En los espacios más cerrados, donde el acceso depende de invitaciones, el material suele ser más extremo y con menor nivel de control.

Dentro de estas comunidades, la violencia también aparece como un código compartido. “Mi madre siempre dijo ‘el diálogo es la solución’ y mi bate se llama diálogo”, escribió un usuario. Otro respondió: “Un bate es un arma que se camufla para deporte”. Este tipo de intercambios que combina ironía con referencias explícitas a armas forma parte de una lógica interna donde el lenguaje funciona como forma de pertenencia.

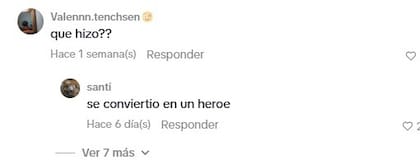

Las conversaciones no se limitan a experiencias personales o fantasías. También incluyen menciones a masacres ocurridas en distintos países y referencias a casos recientes en la Argentina. El ataque en una escuela de Santa Fe aparece como uno de los temas recurrentes. En paralelo, en TikTok, algunos usuarios se dirigen a cuentas vinculadas a ese episodio y dejan mensajes que califican al autor como un “héroe”, en una dinámica que replica patrones de glorificación ya observados en otros contextos.

En ese mismo ecosistema digital se inscribe la denominada True Crime Community (TCC), una subcultura que también tiene presencia en la Argentina y que se estructura a partir de la circulación constante de contenidos vinculados con hechos de violencia extrema.

A diferencia de lo que ocurre con otros fenómenos, no tiene líderes visibles ni una organización formal: funciona de manera fragmentada, a través de usuarios que comparten referencias, símbolos y relatos en distintas plataformas.

En estos espacios, los episodios violentos dejan de ser solo objeto de interés y pasan a integrarse en dinámicas de intercambio donde se comentan, se reinterpretan y, en algunos casos, se incorporan como parte de una identidad colectiva. A medida que aumenta el nivel de involucramiento, el contenido no solo se consume, sino que también se reproduce y resignifica dentro de la comunidad.

Este tipo de circuitos tiende a intensificarse tras hechos de alto impacto. La aparición de nuevos casos suele ir acompañada de una mayor circulación de mensajes, imágenes y referencias, lo que puede derivar en amenazas o en la repetición de conductas, en un proceso que encuentra en estas plataformas un canal de expansión constante.

El perfil predominante que surge de estos entornos coincide con lo observado por LA NACION: adolescentes y jóvenes que participan en espacios donde predominan códigos propios, referencias compartidas y dinámicas de interacción que, en algunos casos, refuerzan discursos vinculados a la violencia.

Qué dice la ley

Los contenidos que circulan en plataformas como Discord o Telegram pueden tener distintas implicancias penales según el contexto y su alcance. El Código Penal contempla figuras como amenazas (art. 149 bis), cuando un mensaje genera temor concreto sobre la posibilidad de un daño; intimidación pública (art. 211), en casos donde se busca provocar alarma social −por ejemplo, con advertencias sobre ataques−, e incitación a la violencia (art. 212), cuando se promueve que otras personas cometan delitos.

También existe la figura de apología del delito (art. 213), que sanciona la exaltación de hechos delictivos o de sus autores, aunque su aplicación suele ser más restrictiva y depende de que exista una justificación clara y con impacto público.

“No todo lo que circula en estos espacios entra automáticamente en el Código Penal, pero sí forma parte de lo que hoy se analiza en investigaciones de ciberdelito”, explicó a LA NACION el especialista en ciberdelitos Sebastián Monsalve.

“Muchas veces el primer indicio no es una amenaza directa, sino un conjunto de señales: usuarios que comparten cierto tipo de contenido, que interactúan siempre entre sí y que van construyendo un clima donde la violencia deja de ser algo excepcional”.

“Desde el punto de vista técnico lo que se hace es reconstruir esas interacciones: ver cómo se mueven esos mensajes, quiénes participan, qué nivel de actividad tienen. No es solo mirar un posteo aislado, sino entender la red”, agregó.

“Cuando ese análisis muestra que hay reiteración, que hay validación entre pares o que alguien empieza a dar un paso más −por ejemplo, pasar de lo simbólico a lo concreto−, ahí es donde puede intervenir la Justicia”, precisó.

Según señaló, uno de los principales desafíos es que estas dinámicas se dan en plataformas cerradas o semiprivadas. “No siempre es contenido visible para cualquiera. Muchas veces está en grupos, canales o servidores específicos, lo que hace más difícil detectarlo a tiempo. Por eso, gran parte del trabajo en ciberdelito hoy tiene que ver con anticiparse: identificar patrones antes de que haya un hecho concreto”.

1

1- 2

Encontraron a una mujer muerta y a otra inconsciente en un departamento de Recoleta

3

3Procesaron al empresario Marcelo Porcel por abusar sexualmente de los compañeros de colegio de sus hijos

4

4El 20 de abril se conocerá el veredicto del juicio a Felipe Pettinato por el incendio donde murió el neurólogo Melchor Rodrigo