App CuidAR: los expertos piden cambios y más control sobre el destino de los datos

1 minuto de lectura'

1 minuto de lectura'

Al cierre de la última cadena nacional del presidente Alberto Fernández, donde se anunciaba una nueva prórroga de la medida de aislamiento obligatoria, se dijo algo que bien podría haber pasado desapercibido respecto de la instalación de una app en los teléfonos de las personas que tuvieran permiso para circular.

"Hay algo que les quiero contar, que en los próximos días Santiago Cafiero les explicará más en detalle, que es que a medida que nosotros vayamos autorizando actividades, y las actividades que los gobernadores vayan autorizando, todo el que vuelva a trabajar tiene la obligación de bajar una aplicación del gobierno nacional que se llama CuidAR, y en esa aplicación uno se somete a un autocontrol y eso nos permite hacer un seguimiento de la persona en lo que hace a su calidad sanitaria", fueron las palabras exactas.

Adelantándose a las preguntas que pudieran surgir, Fernández aclaró que "cómo funciona esa aplicación se los va a contar Santiago [Cafiero] mañana o pasado tal vez". Y concluyó: "No soy un millennial, esto no es lo mío".

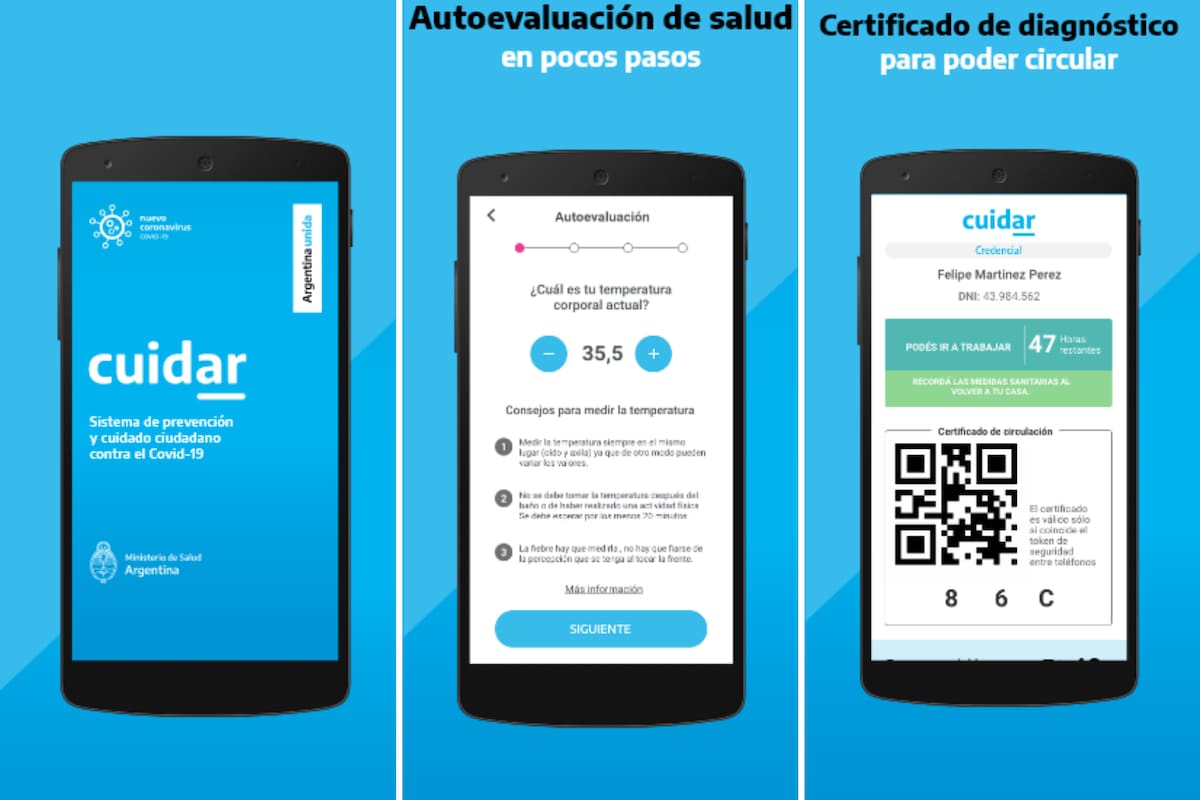

Esta nueva versión de la app, introduce la novedad de sincronizarse con los datos del Certificado Único Habilitante para Circulación y cuenta con la potestad de revocar o renovar los permisos a partir del proceso de autodiagnóstico del portador. La app ya tendría más de 2 millones de descargas, entre los usuarios de iOS y Android.

Inmediatamente después del anuncio un número de voces vinculadas a la protección de la privacidad y el análisis crítico de la tecnología en políticas públicas se alzaron a cuestionar, entre otras cosas, el carácter obligatorio de la aplicación, que entre los permisos que solicita estuviera la ubicación, la imposibilidad de corregir errores en el autodiagnóstico o apelar una revocación del CUHC, el método por el cual se valida la identidad, por cuánto tiempo quedarán registrados los datos, para qué serán utilizados, etcétera.

La Argentina no está sola en esto: múltiples países están usando aplicaciones para rastrear, con diverso grado de precisión, el movimiento de su población y, en especial, de las personas contagiadas de coronavirus.

La respuesta oficial

Quizá en respuesta a estas inquietudes, algunas de ellas abrazadas por la oposición, el jefe de Gabinete de Ministros de la Nación, Santiago Cafiero, un día después hizo algunas aclaraciones. En particular, afirmó que la app no puede poner en riesgo los datos personales de quienes la usen y enfatizó que "activar la geolocalización es opcional y voluntario".

Sus palabras fueron más medidas que las del presidente, indicando que el uso de la app es "promovido" por el gobierno pero no obligatorio, en contradicción con el anuncio original, y que lo que se mantiene obligatorio, esperablemente, es la posesión del permiso para circular.

Sin embargo, estas declaraciones en gran parte dependen de la confianza en sus palabras. Como señaló Delia Ferreira: "comprobar que el manejo de datos es como dice Cafiero requiere la apertura del código [fuente del software] que no afectaría para nada la protección de la salud". Asimismo, respecto de la geolocalización, el programador y profesor Maximiliano Firtman remarca que en versiones más antiguas de Android no es posible desactivarla; esta versión de Android es la que está presente en un cuarto de los celulares en uso en el país.

El presidente informó que la app "CuidAr" será obligatoria para los que trabajen. No salió resolución pero analicé la app y aquí va hilo con detalles. ¿Es segura? ¿qué hace la app? ¿me sigue a donde voy? ¿qué podría hacer una actualización futura? ¿la voy a poder instalar? + pic.twitter.com/DWPQErNUr6&— Maximiliano Firtman (@maxifirtman) May 9, 2020

Y no hay motivos para confiar en que la ubicación queda anonimizada. Esto se desprende de la descripción misma de las funciones de la aplicación.

Aunque muchas de las críticas frente al anuncio original contemplaron que recién cuando la medida estuviera formalmente descrita en un decreto se conocería en detalle la naturaleza de la aplicación, el Decreto de Necesidad y Urgencia 459/2020 apenas si la menciona.

No se sabe cómo funciona la aplicación

En lo que parece haber relativo consenso es en que anuncios de este tipo ameritan una comunicación más clara y atenta. Firtman comenta que "en muchos medios y también en entrevistas a funcionarios que tratan de explicar qué hace la app no siempre se dice exactamente qué hace, y eso puede ser mal interpretado para un lado o para el otro". Fue precisamente esta incertidumbre lo que lo inclinó a hacer ingeniería inversa de la aplicación y compartir algunos de sus hallazgos.

En esto coincide Javier Pallero, analista de Políticas Públicas para Internet de América Latina y el Caribe en la ONG Access Now. Esta falta de claridad respecto de cuál es el plan para la aplicación supone "el peligro de lo que llaman mission creep, esto es, ir ampliando el objetivo y funciones de un esfuerzo político o técnico más allá de lo que se dijo originalmente", argumenta.

Se desconoce qué más hará

A lo que alude es a que la aplicación CuidAR se introdujo como una mera herramienta de autodiagnóstico en la que el usuario indicaba si presentaba síntomas, tanto en su teléfono o navegador web, y esta indicaba los pasos a seguir en caso de dar positivo. Es sobre esta funcionalidad que ahora se agrega la de portar el certificado que habilita a la circulación.

"Entonces si tu autodiagnóstico da posibilidades de que tengas síntomas", explica Pallero, "o el servidor determina que los tenemos, nuestro certificado de circulación queda invalidado". Al atarse el certificado de circulación con el autodiagnóstico, una práctica ciertamente falible, algunas personas podrían quedar invalidadas para circular a pesar de no tener un diagnóstico confiable.

Cómo afecta a los derechos humanos

Es fundamental conocer cómo incide cualquier esfuerzo tecnológico en nuestros derechos para poder hacer una evaluación de riesgos y de impacto. Pero esto no es posible si no hay un plan claro y las funciones van cambiando sin previo aviso.

Pallero también señala que esto es especialmente pertinente cuando consideramos que a esta aplicación se le ha agregado la capacidad de registrar la ubicación de las personas. "Esa funcionalidad está construida dentro de la app. El Estado dice que la usa solamente para el autodiagnóstico, pero en tanto su código esté cerrado no es posible saberlo con certeza", aclara Pallero.

De hecho, que los investigadores deban hacer ingeniería inversa para conocer su funcionamiento también apunta en la dirección de una crítica frecuente cuando se implementa tecnología en el ámbito público: al tratarse de un desarrollo de código cerrado no es posible conocer exactamente cómo funciona.

Si bien oficialmente el asunto de la geolocalización estaría restringida a los casos positivos, no tenemos esa garantía. Pallero agrega: "El día de mañana podría indicarse que tal grupo o tal barrio está registrado como enfermo, o lo que sea, para habilitar la vigilancia permanente. Esta función no está clara ni está explicitada en la aplicación"

Una preocupación levantada por Firtman tiene que ver con la validación de datos personales. "Esto no tiene que ver con una vulnerabilidad de seguridad sino que hay un problema de diseño en torno a cómo se pensó la aplicación en cuanto al registro del DNI. La manera de validar la identidad no es tan precisa como uno creería que debería ser. Y en tanto esto es una declaración jurada que dispara una reacción del sistema de salud con la capacidad de revocar un permiso de circulación, se vuelve preocupante".

El problema que señala Firtman es que los datos utilizados para validar el DNI se encuentran en bases de datos que si bien no son públicas, se pueden conseguir con relativa facilidad, en efecto haciendo posible la suplantación de identidad y la falsificación de la declaración jurada, potencialmente dejando a alguien sin la posibilidad de circular a pesar de haber obtenido un certificado.

Esta falta de transparencia y la ampliación paulatina de funciones se vuelve especialmente acuciante al agregar la geolocalización. Esto no significa que vayan a usarse con malas intenciones, sino que siempre es mejor que la función no exista o que esté desagregada, de tal modo que se evite el peligro de un mal uso.

Confiar en la app, el mayor desafío

Delia Ferreira, presidenta de Transparencia Internacional, el movimiento global anticorrupción, pone también el foco en la transparencia, "central para que cada persona sepa cuál será el destino de sus datos personales, quién podrá acceder a ellos, con qué fin se utilizarán, a qué terceros se dará acceso, cómo se garantiza la seguridad de los datos, cuánto tiempo se almacenarán los datos". Además, señala, en todo momento la persona tiene derecho a saber qué datos de ella están en manos del gobierno y a corregirlos si fueran equivocados.

Sin esta transparencia se daña indefectiblemente la confianza en la seriedad y capacidad de quien manipulará los datos. Esto, según Ferreira, puede resultar "en que se altere la respuesta de la ciudadanía frente a las aplicaciones de traza de contactos, geolocalización, ‘pasaporte biológico’ y ‘autodiagnóstico’ que suponen la cesión de datos. Los gobiernos que tienen altos estándares de protección efectiva de los datos de la población generan mayor confianza para la entrega de datos. En otros países, donde los sistemas de protección de datos no son eficaces, donde se producen filtraciones de datos o las bases de datos y sistemas digitales son hackeados, la confianza disminuye considerablemente".

Tanto Firtman como Pallero coinciden en este punto: el mayor desafío para la implementación de una app como CuidAR es la confianza.

"Hay un doble problema de posible desconfianza y un problema de excesiva confianza", explica Pallero. "El problema de la excesiva confianza es esta idea alimentada por los medios y quizá por algunas personas de ciertas esferas de gobierno de que las aplicaciones son buenas y necesarias para salir de la cuarentena, por ejemplo para hacer rastreo de contactos (contact tracing). Primero, esta aplicación no hace contact tracing y segundo si lo hiciera lo haría de maneras poco específicas, como sucede en Jujuy donde se hace con sistema de GPS y wi-fi, que es muy poco exacto", subraya.

Firtman, por su parte, señala que la mala comunicación desencadena desconfianza: "Algunas personas están asustadas con lo que hace la aplicación y esto se puede rastrear al problema de la falta de comunicación y que no quede claro qué hace, cómo lo hace, qué dispara, en qué momentos y por qué. Y mucha gente puede terminar deshabilitando ciertos permisos por seguridad y la app no funciona o se generan problemas".

A lo que alude es a que una buena práctica, para la aplicación que sea, es informar al usuario para qué se pide cada permiso. A veces un permiso se pide para ciertas funcionalidades acotadas aunque suene más grave de lo que es. Un ejemplo es el pedido de acceso a los SMS para verificar nuestro número en aplicaciones como Telegram o WhatsApp: el pedido de este permiso no significa que la app vaya a estar leyendo todos nuestros mensajes.

La desconfianza en este tipo de aplicaciones se vuelve incluso más grave cuando tenemos en cuenta que para que los esfuerzos de rastreo de contactos sirvan para algo su adopción debe ser masiva. Y es por esta desconfianza que muchas autoridades sanitarias están rechazando las soluciones tecnológicas para lograr el rastreo, optando en cambio por realizarlo a la vieja usanza: con humanos.

La falsa dicotomía entre privacidad y salud

"El derecho a la privacidad y la protección de datos personales son derechos fundamentales para la protección de la autonomía y libertad de la persona. La emergencia no es un cheque en blanco que justifique el avasallamiento de estos derechos", explica Ferreira. "Las medidas de emergencia deben respetar el Estado de Derecho, el principio de legalidad. Los datos sobre la salud son datos sensibles de acuerdo a la ley argentina y en la mayor parte de los países del mundo", agrega.

Es un lugar común últimamente el contraponer derechos como si fueran opuestos o como si la renuncia a ellos fuera un requisito. En Argentina "la ley autoriza la recopilación para fines de investigación y estadística de datos sobre la salud de las personas a condición de que estos estén anonimizados y agregados —es decir que la persona no pueda ser identificada y asociada con los mismos. Cuando se pretende acceder a datos de salud y al mismo tiempo identificar a la persona —como es el caso de la aplicación CuidAR— se requiere el consentimiento de la persona", argumenta Ferreira.

Es por este punto que se volvió tan alarmante el anuncio de Fernández respecto de la obligatoriedad del uso de la aplicación, una situación que solo se repitió en India. En este caso se hubiera excluido el consentimiento aunque la persona aceptara los términos y condiciones de la aplicación al instalarla. "Esa aceptación no es libre y el consentimiento está viciado", sostiene Ferreira.

No es Facebook ni TikTok

No faltaron las voces que se apresuraron a señalar que si a diario instalamos una miríada de apps que manejan datos sensibles, como Facebook, Instagram o TikTok, pero las situaciones no son comparables porque dichas aplicaciones no son obligatorias para nadie. "En la mayoría de los países que utilizan o estudian la incorporación de este tipo de aplicaciones (incluida la que desarrollan Apple y Google sobre Bluetooth) el uso de las mismas es voluntario para la población, no obligatorio", señala Ferreira.

Tampoco es sensato discutir estas soluciones en términos absolutos: los derechos no lo son. "Es indispensable mantener un equilibrio razonable para su ejercicio armónico. Puede haber alguna limitación pero debe ser mínima, limitada, razonable y de duración limitada", aclara Ferreira.

"El problema con los datos personales", sostiene Ferreira, "es que una vez que han salido de la esfera de la privacidad es difícil restaurar la reserva total sobre los datos revelados (movimientos, contactos, enfermedades, signos vitales, domicilio etc). Y la situación se agrava en el caso de estas aplicaciones por los permisos que solicitan y por aquellos que están instalados por default y a veces ni siquiera pueden deshabilitarse (acceso a contactos, cámara, micrófono, localización, etcétera)".

En el caso de las aplicaciones desarrolladas en la lucha contra la COVID-19, y como se señaló más arriba, se pone en alerta la posible violación del derecho a la privacidad, que se vincula al peligro del establecimiento de un estado de vigilancia permanente del Estado sobre los ciudadanos. "El riesgo es aceptar la limitación de derechos por la emergencia y que después esas limitaciones se normalicen. En Argentina las emergencias suelen durar para siempre y además venimos de una reciente discusión aún no zanjada sobre la vigilancia en redes sociales", acota Ferreira.

Es posible pensar alternativas

Pallero confía en que se podría haber desarrollado la aplicación respetando el el principio de necesidad, un elemento básico de los Derechos Humanos. Este alude a que si hay que tomar una decisión que limite derechos humanos, esta debe tomarse de tal modo que produzca el menor impacto sobre esos derechos.

En esto coincide Ferreira, que apunta que "durante situaciones de emergencia los gobiernos adoptan medidas excepcionales pero no pueden afectar los derechos y libertades de las personas más allá de lo estrictamente indispensable para el logro del objetivo perseguido. Las medidas deben ser adecuadas y proporcionales".

En concordancia con los principios establecidos por Naciones Unidas —y para el caso específico de las aplicaciones de rastreo de contactos bajo los parámetros establecidos recientemente por la Comisión Europea— las medidas gubernamentales deben ser transparentes y sujetas a control y rendición de cuentas.

En particular, para Pallero es crucial el asunto de la geolocalización: "No veo por qué la aplicación debe tener un sistema de control permanente de ubicación listo para ser usado para el caso que estés enfermo. Ningún aislamiento se va hacer correctamente solo usando una aplicación. Si se quiere hacer rastreo de contactos eso es otra cosa. Se tratará de una aplicación distinta que debería encararse con otra mentalidad diferente. A esto remite la discusión de Google y Apple".

En otras palabras, la aplicación se podría haber desarrollado con un objetivo, unas herramientas y un planteo del problema distinto, más adecuado y menos invasivo. Firtman, Pallero y Ferreira coinciden en que la aplicación debería haberse desarrollado con código abierto "para que no tenga que haber gente decompilando la aplicación, violando términos de uso y exponiéndose a responsabilidades legales, tratando de entender qué hace la aplicación que se supone que es desarrollada con dinero público y un objetivo público", agrega Pallero.

En un artículo publicado unos días antes de la cadena nacional del presidente, una serie de investigadores de la UBA-CONICET y Fundación Sadosky analizaron las alternativas tecnológicas actuales, en particular el uso de aplicaciones, que podrían colaborar para la añorada "liberación incremental de la cuarentena".

Allí lo que señalan es que "para salir de casa, menos es más" en alusión a que una app podría simplificar muchas cuestiones, principalmente en torno al certificado de circulación, pero que "para llevar adelante este modelo no es necesario que la aplicación monitoree nuestros movimientos, ni monitoree con quién estuvimos ni quién tuvimos cerca". Incluso, sugieren una función interesante: "la posibilidad de hacer denuncias ante aglomeraciones indebidas de gente (por ejemplo, un comercio que no respeta la distancia social, una fiesta privada o un medio de transporte sobrepoblado)".

De acuerdo al mismo artículo, sus autores colaboraron con la Secretaría de Innovación Pública en el desarrollo de la aplicación CuidAR, aunque el mismo "expresa la opinión individual de los autores y no de las instituciones a las que pertenecen, ni de la Secretaría".

Salir de casa sin meternos en problemas

Por momentos parece percibirse un incrementado respeto por la ciencia y quienes realizan tareas de investigación a diario. Una vez más, la ciencia es puesta en el privilegiado lugar de ser la linterna que ilumine en un escenario incierto, en constante cambio y plagado de decisiones difíciles, e incluso imposibles, de tomar. Este reconocimiento público incluso se hace eco en la expresión, a veces inexplicablemente peyorativa, del gobierno como uno "de científicos".

Pero entre el manojo de ansiedades que esta situación provoca inescapablemente a veces se introduce la ciega fe en la tecnología, como ese secuaz de la ciencia que aprovechando el conocimiento que esta produce llegará, con heroísmo y en el momento justo, para salvarnos o, al menos, permitirnos volver a pisar una plaza o recordar cuál era el mundo que habitábamos hace apenas tres meses.

En el campo de la crítica a la tecnología rara vez se obvian o subestiman sus virtudes, pero la atención permanente al vicio del solucionismo es un hábito que es celosamente observado por quienes creen en que la tecnología hace simultáneamente del mundo un lugar mejor siempre y cuando siempre estemos al volante.

Las situaciones de absoluta excepcionalidad como la que provoca la pandemia del nuevo coronavirus solo son el ejemplo más reciente de cómo desde el afán por las soluciones tecnológicas pueden cometerse atropellos contra los derechos fundamentales de las personas. Es por esto que la mayoría de excusas están gastadas y fueron refutadas ampliamente incluso hace décadas.

No se trata de echar por tierra las iniciativas gubernamentales o privadas que proponen a la tecnología como herramienta fundamental para nuestra supervivencia o bienestar, sino de recordar que la amplia mayoría de estas críticas no son en absoluto nuevas.

Bienvenida sea la tecnología, una vez más, solamente no perdamos de vista todos los derechos que hasta ahora supimos conseguir.

1

1¿Cómo saber si hay alguien conectado a mi red de wifi?

2

2La escasez de memoria RAM seguirá hasta 2027 al menos: solo se cubrirá el 60% de la demanda

3

3Así funciona la cámara del Oppo Find X9 Ultra, el smartphone que busca redefinir la fotografía móvil

- 4

El desconocido dato de los mercados que revela qué empresas están quedando obsoletas con el avance de la IA y cuáles no