Gemini vs. ChatGPT vs. Claude: “Hay dos que son los mejores modelos de inteligencia artificial”

Un sitio especializado hizo la comparación de modelos de inteligencia artificial con prompts idénticos; cuáles son los más potentes, rápidos y baratos del mercado

3 minutos de lectura'

3 minutos de lectura'

La carrera global por el desarrollo de inteligencia artificial avanza a gran velocidad y una reciente comparación entre modelos muestra cómo distintas empresas tecnológicas compiten por liderar áreas clave como capacidad de razonamiento, velocidad de respuesta, latencia, precio y tamaño de contexto en las respuestas.

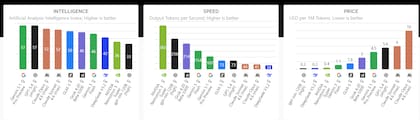

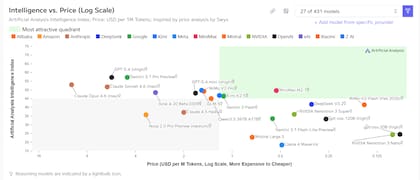

Según el sitio especializado Artificial Analysis, en el apartado de inteligencia, los modelos que encabezan el ranking son Gemini 3.1 Pro, desarrollado por Google, y GPT‑5.4 de OpenAI. Ambos aparecen como los sistemas con mayor capacidad de procesamiento y razonamiento dentro de la comparación. Detrás de ellos se ubican GPT‑5.3 Codex y Claude Opus 4.6, este último creado por Anthropic.

Las métricas de rendimiento se obtuvieron mediante pruebas estandarizadas con prompts idénticos aplicados a 431 modelos distintos, lo que permite comparar su desempeño de manera objetiva.

Los modelos más rápidos

En cuanto a velocidad de generación de texto (tokens por segundo), el ranking cambia. El modelo más veloz es Mercury 2 con aproximadamente 732 tokens por segundo, seguido por Granite 4.0 H Small, desarrollado por IBM, con alrededor de 452 tokens por segundo.

Detrás aparecen modelos de la familia Qwen 3.5, creados por Alibaba, que también destacan por su rendimiento.

Menor latencia: respuestas casi instantáneas

Otra métrica clave es la latencia, es decir, el tiempo que tarda el sistema en empezar a responder. Aquí lidera Gemini 2.5 Flash‑Lite con aproximadamente 0,33 segundos, seguido muy de cerca por Qwen 3.5 0.8B con 0,34 segundos.

También aparece entre los modelos de baja latencia Apriel‑v1.5‑15B‑Thinker, lo que demuestra que diferentes laboratorios están optimizando sus sistemas para ofrecer respuestas más inmediatas.

Los modelos más baratos

El precio por millón de tokens es otro factor clave para empresas y desarrolladores. Según la comparación, el modelo más económico es Qwen 3.5 0.8B, con un costo aproximado de 0,02 dólares por millón de tokens.

Entre las alternativas de bajo costo también se menciona Gemma 3n E4B, otro modelo desarrollado por Google.

Contexto: la capacidad de “memoria” del modelo

El tamaño de la ventana de contexto —la cantidad de información que un modelo puede procesar en una sola interacción— es otro indicador relevante. En este rubro destaca Llama 4 Scout de Meta, con una impresionante capacidad de hasta 10 millones de tokens.

Le sigue Grok 4.20 Beta 0309, desarrollado por xAI, con cerca de 2 millones de tokens, mientras que Gemini 2.0 Pro Experimental también figura entre los modelos con mayor contexto disponible.

Una competencia tecnológica cada vez más intensa

La comparación refleja cómo la industria de la inteligencia artificial se está diversificando rápidamente. Mientras algunos modelos priorizan capacidad de razonamiento, otros se enfocan en velocidad, eficiencia o costos más bajos.

Esta competencia entre gigantes tecnológicos y nuevos laboratorios de IA anticipa un escenario en el que los modelos serán cada vez más especializados, con herramientas optimizadas para programación, análisis de datos, generación de contenido o asistentes conversacionales avanzados.

1

1La IA eligió el mejor artista argentino de la historia y la respuesta no es lo que muchos imaginan

2

2JBL actualiza sus parlantes Xtreme 5 y Go 5 con sonido más potente y diseño renovado

3

3Así se puede encontrar la papelera de WhatsApp para recuperar mensajes viejos

4

4WhatsApp habilita la transferencia de chats entre plataformas y una nueva función para liberar espacio